人工知能(AI)の可能性を最大限に引き出すためのガイダンス(AIの実装と拡張に役立つCOSOフレームワークと原則の適用)

「人工知能(AI)の可能性を最大限に引き出すためのガイダンス(AIの実装と拡張に役立つCOSOフレームワークと原則の適用)」(原題: Realize the full potential of artificial intelligence - Applying the COSO Framework and Principles to help implement and scale artificial intelligence、以後、本稿ではCOSO-ERMのAI適用ガイダンスと呼びます)は、今後、普及が進んでくるであろうAIに関わる不確実性を組織が適切にコントロールし、企業価値向上に最大限役立てるための考え方を示すものです。米国組織COSOと米デロイトが共同執筆し、2021年9月15日に公表しました。

COSO-ERMのAI適用ガイダンスが公開された背景

このガイダンスが公開された背景には、AIが人類にもたらすベネフィットの増大に比例して、マイナスの影響に対しても懸念の声が広がっていることがあります。ガイダンスでは、AIがもたらすリスクについて言及しています。例えば次のようなものです。

- 不適切または不十分なデータによるバイアス(偏り)および信頼性の低下

- AIモデルの意思決定プロセスのブラックボックス化

- 不適切なデータ利用

- データの不正入手やAIモデルの不正操作を目的とした攻撃に対する脆弱性

- AI技術の急速な適用と変化による社会的ストレス

すでにこうした懸念は一部で現実のものとなっています。例えば、フェイスブック社は同社のSNS上に掲載する広告が「バイアスのかかったアルゴリズムにより自動選別されている可能性がある」として平等法(英国)違反の非難を受けています。

こうした事態を受け、各方面でリスクコントロールに向けた自主的な動きが加速しました。2017年にはマイクロソフト社が、透明性や公平性を担保するために、AI倫理の委員会を発足させました。2018年にはグーグル社が、研究開発および製品開発の方針を精査し、意思決定に影響を与える具体的なAIに関する原則を発表しました。また、2021年にはソニーグループが自社製品の品質管理プロセスにAI倫理の基準を導入すると発表しました。

さらに、NIST(米国国立標準技術研究所)が、AIのリスクマネジメントフレームワーク(AI RMF)策定に向けて動き出しています。COSO-ERMのAI適用ガイダンスも、まさにこうした世の中の流れを受けて発表されました。

COSO-ERMのAI適用ガイダンスの構成

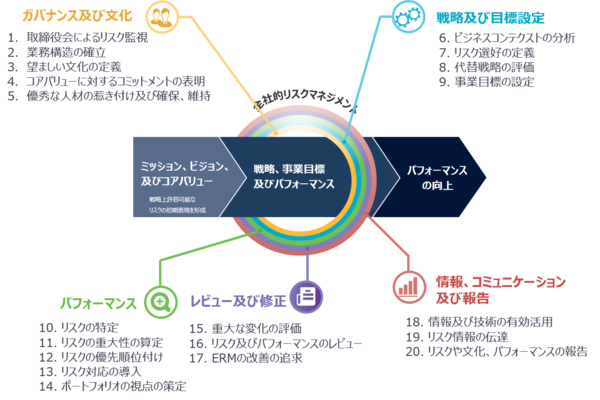

COSOは2021年7月、COSO-ERM for Cloud Computing(COSO-ERMのクラウドコンピューティングへの適用ガイド)を公表しており、COSO-ERMの AI適用ガイダンスは、それと類似した構成になっています。具体的には、COSO-ERMが示すフレームワークである5つの要素と各要素に含まれる20の原則それぞれを「AIのリスクマネジメントに適用する際にはどこがポイントになるか」といった視点で、解説しています。なお、ERMとは全社的リスクマネジメント(Enterprise Risk Management)の略称で、COSO-ERMが示すフレームワークは下図の通りです。

【図1:COSO-ERM(2017)のフレームワーク】

従って、COSO-ERMのAI適用ガイダンスの目次構成は次のようになっています。

- はじめに

- AI革命:

ビジネスの変革とイノベーション - COSO-ERMフレームワーク:

全体的なビジネス戦略及びIT戦略に沿ったAIリスクへの対応 - ガバナンス及び文化

- 戦略及び目標設定

- パフォーマンス

- レビュー及び修正

- 情報、コミュニケーション及び報告

- まとめ

出典:COSO-ERMのAI適用ガイダンスの目次を基にニュートン・コンサルティングが翻訳

COSO-ERMのAI適用ガイダンスが示すフレームワーク適用の要旨

COSO-ERMのAI適用ガイダンスの中身について見ていきましょう。詳細は下表の通りです。

| 目次 | 各章(COSO-ERMの5つの要素)の要旨 |

|---|---|

| Governance and Culture (ガバナンス及び文化) |

組織のピラミッドの頂点からAIに関する統制をかけることが必要。現時点ではAIの導入や活用に関して経営層が積極的に関与できる体制になっている組織が多いとは言えず※1、何らかの形で関与するよう仕向けていく必要がある また、現時点で画一的なAIリスクマネジメントフレームワークは存在しないが、そうしたものをCOSO-ERMを補完するフレームワーク※2として採用することが望ましい ※1.調査したAI採用企業のうち、AIに関して役員クラスの責任者をおいている企業は26%だった ※2.本ガイダンスでは「公平性・堅牢性・プライバシー・安全性・説明責任・透明性」などの要素を含む独自のフレームワークを紹介している |

| Strategy and objective-setting (戦略及び目標設定) |

企業の戦略策定の際に、AIの導入や活用に関する戦略やリスク選好(リスクをどの場面でどこまで積極的に取るのかなどの方針)も併せて検討する必要がある。その際、AIモデル※や利用対象となるビジネスごとにリスク特性も変わる可能性が高いため、それぞれで戦略やリスク選好を検討することが望ましい ※AIモデルとはAIのアルゴリズムのこと。いくつかの種類があり、深層学習(ディープラーニング)や、決定木、クラスタリング、回帰などの非深層学習がある |

| Performance (パフォーマンス) |

AIモデルやそれを活用するビジネスに合わせて、それぞれでリスクアセスメントを実施することが望ましい。リスクアセスメントを行う際には、「ガバナンス及び文化」でも言及したリスク特定や分析・評価を助けるリスクマネジメントフレームワークなどを活用することが望ましい AIに関するリスクアセスメントやリスク対応の結果を受けて、どのような観点でリスクや課題の大きさ、管理の進捗状況に関する情報をまとめるのかを考え、経営層に報告できるようにすることが望ましい |

| Review and Revision (レビュー及び修正) |

AIのリスク対応のモニタリング、リスクマネジメントのあり方や運用の仕方そのもののレビューを行い、継続的改善につなげられるような仕組みを確立することが望ましい こうした活動を通じて、徐々にどのようなリスク分類でリスク認識や管理を進めるのが良いか検討し、継続的改善を図っていくことが望ましい |

| Information, Communication, and Reporting (情報、コミュニケーション及び報告) |

AIに関するリスク情報やリスク対応結果、その課題などについてどのように組織内外とコミュニケーションを取るのか、明確化することが望ましい 特にAIについては、情報を伝えた際の受け手の感情に留意することが重要であり、その点も加味したコミュニケーションプロセスを確立することが重要である。また、同じ理由から、風評リスクが顕在化するなど危機が発生した場合のクライシスコミュニケーションやクライシスレスポンス(危機対応)、あるいはその管理(危機管理)についても検討し、確立しておくことが望ましい。 |

※「各章の要旨」は筆者が作成

COSO-ERMのAI適用ガイダンスの活用方法

このガイダンスは、組織のリスクマネジメント部門やシステム部門、AI利用部門などの方に有益です。特に以下のいずれかに該当する方に、活用を推奨します。

- これからERM構築を進めるが、AIリスクも意識する必要があると感じている

- ERM構築済みだが、AIのリスクマネジメントが弱いと感じている

- AIへの依存度はまだ高くないが、今後のために勉強しておきたい

- AIの研究や導入に向けた動きが活発化しているが、組織としてリスクマネジメントの観点での動きはできていない

もちろん、上記以外の方にも参考になる情報がありますので、部分的な利用も可能です。COSO-ERMのAI適用ガイダンスは、COSOの公式ページからダウンロードすることができます。ただし、残念ながら英語版のみですので、本稿に書いたポイントを参考にした上で、気になる箇所を参照してみることをお勧めします。