AI事業者ガイドライン(第1.0版)

「AI事業者ガイドライン(第1.0版)」(以下、AI事業者ガイドライン)は、安全・安心を伴ったAIの活用促進を狙いとして、経済産業省と総務省が策定した日本国としてのAIガバナンスの統一的な指針です。AI事業者ガイドラインは2023年12月に案が公表され、意見公募を経て2024年4月19日開催のAI戦略会議において正式に決定されました。なお、AIガバナンスとは、組織において、人間中心のAI社会原則に基づいて倫理的な配慮や安全性確保、説明責任などを実現するためのAI開発・利用・提供等のあり方、体制や仕組みを指します。また、「統一的な指針」という言葉には、過去数年間にわたりAIの用途に合わせて別々に発行されてきたガイドラインを統合し、1冊にまとめたものという意味が込められています。

AI事業者ガイドラインとは

AI事業者ガイドラインは従来のガイドラインを統合、改定してとりまとめられました。具体的には目的ごとに別々に発行されていた以下の3つを指します。

- 開発:AI開発ガイドライン(総務省、2017年)

- 利用:AI利活用ガイドライン(総務省、2019年)

- 運用:AI原則実践のためのガバナンス・ガイドライン(経済産業省、2022年)

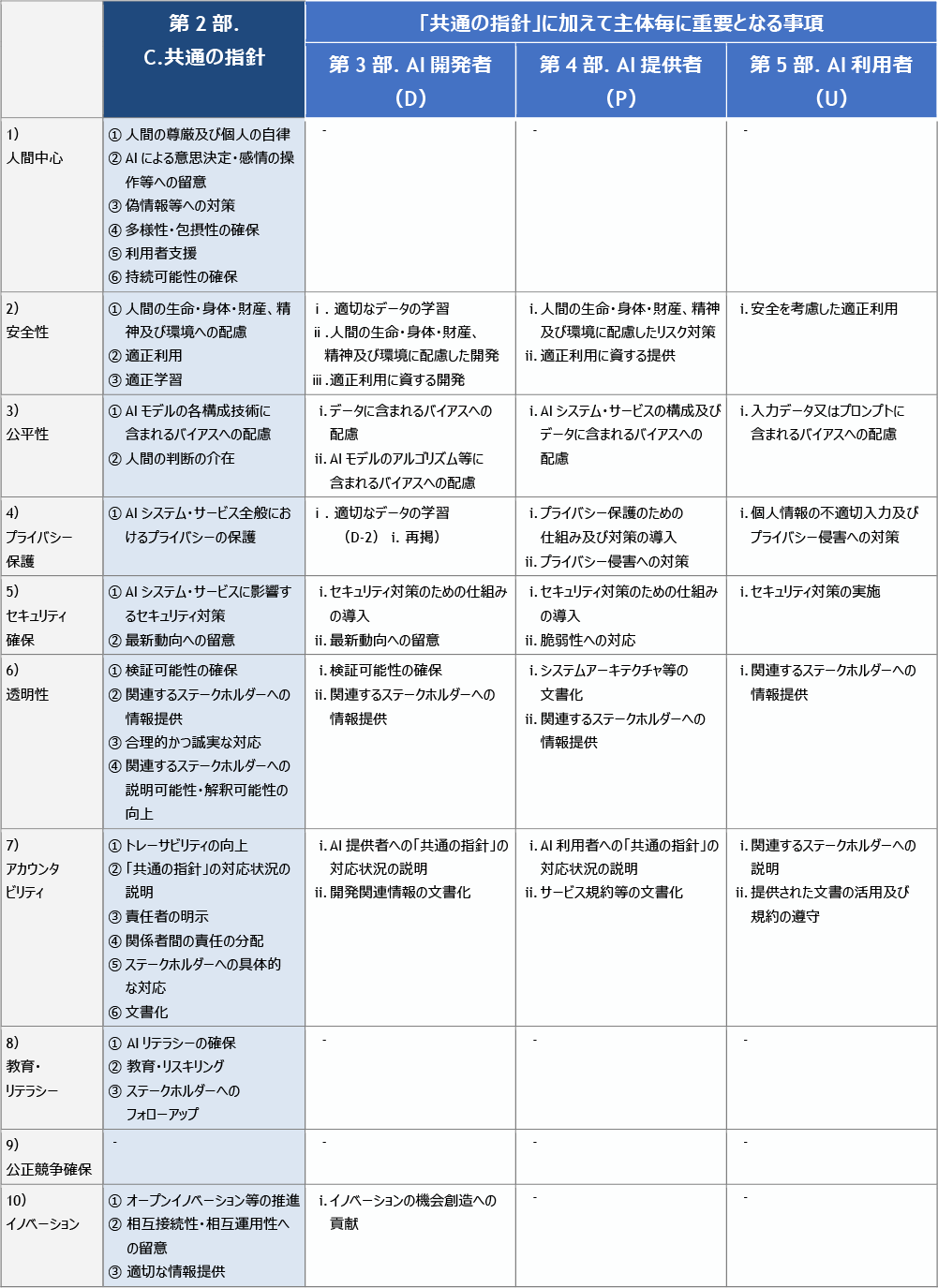

AI事業者ガイドラインの構成

AI事業者ガイドラインはガイドラインとしては比較的重厚で、本編(35ページ)に別添資料が計9つ、別添1~6までをまとめた資料は総ページ数157ページとなります。本編には、AIの「原則」と、これに紐づく重要事項が記載されています。

なお、AIの「原則」というと、2019年にOECDにて採択されたAI原則や、2023年にG7にて採択されたAI活用5原則、総務省が発行したAI利活用ガイドラインにて言及されるAI利活用原則など、様々なものがあります。AI事業者ガイドラインが掲げるAIの原則は、これら全ての原則を考慮して策定された原則であると言っていいでしょう。

このことがよくわかり、なおかつ、本編の構造を明瞭簡潔に図示したものが以下になります。

AI事業者ガイドラインの特徴

では、AI事業者ガイドラインの特徴は何でしょうか。全部で次の5点にまとめることができます。

- 特徴1)AIのステークホルダー全てを対象にしている

- 世界各国で発行されているガイドラインの多くがAI開発者向けに作られているのに対して、AI事業者ガイドラインは、対象としている範囲が広いのが特徴です。ChatGPTやGoogle GeminiといったAI技術そのものを開発する組織だけでなく、AI技術を搭載した製品やサービスを提供する組織から生成AIを業務に利用する単なる利用者まで、全てを対象としています。

- 特徴2)世界各国のガイドラインや法規制を幅広く取り込んでいる

- 世界各国のガイドラインを参照して作成されています。例えば、米国の科学技術分野における計測・標準に対する国立研究機関であるNISTが世界に先駆けてAI開発組織向けに発行したAI Risk Management Frameworkや、英国と米国の研究機関が共同で策定したGuidelines for secure AI system by UK and United States、ISOのAIマネジメントシステム規格であるISO/IEC42001などについても言及しています。

- 特徴3)リスクベースアプローチを採用している

- AIを取り巻く他の多くのガイドラインと同様、AI事業者ガイドラインもリスクベースアプローチを採用しています。リスクベースアプローチとは、AIの利用形態に伴って生じ得るリスクの大きさを把握した上で、その対策の程度をリスクの大きさに沿ったものにする考え方です。これは開発・利用・提供するAIの機能や性質、その目的によってもたらされるリスクが大きく異なるためです。

- 特徴4)アジャイル・ガバナンスの考え方を採用している

- AI事業者ガイドラインはAIガバナンスの指針ですが、AIガバナンスにはアジャイル・ガバナンスの考え方を採用しています。アジャイル・ガバナンスとは、変化の激しい現代社会において、組織の仕組みのあり方そのものも、環境変化に合わせて柔軟かつ迅速に適応させていこうという考え方に基づくものです。一度定めたルールを長期的に維持するのではなく、組織が掲げた目的やゴールに合わせて、変化に柔軟に対応できる体制構築を目指すものです。なお、アジャイル・ガバナンスのステップは下記6つです。

- 環境・リスク分析

- ゴール設定

- システムデザイン

- 運用

- 評価

- 環境・リスクの再分析

- 特徴5)組織が適用しやすいように巻末にチェックリストやワークシートがついている

- AI事業者ガイドラインの別添7には「全主体向け」、「高度なAIシステムに関係する事業者向け」の2種類のチェックリストが示されています。さらに具体的な実践内容を検討するのに参考となる「具体的なアプローチのためのワークシート」も用意されています。これは、AI事業者ガイドラインの利用者が、当該ガイドラインとの過不足を自ら評価し、不足分に対してどのようなネクストアクションを取るべきか明らかにすることを支援するために作成されたものです。

AI事業者ガイドラインと他のAIガイドラインとの違い

AI事業者ガイドラインの特徴をより理解するために、類似のガイドラインであるAI Risk Management Framework(NIST)およびISO/IEC42001:2023との比較をしてみたいと思います。

ちなみに、英国と米国の研究機関が共同で策定したGuidelines for secure AI system by UK and United Statesについては、AI Risk Management Frameworkに近い位置付けのものであることと、同ガイドラインほど著名ではないため、比較対象からは省いています。

| AI事業者ガイドライン | AI Risk Management Framework | ISO/IEC42001 情報技術 - 人工知能(AI)-マネジメントシステム | |

|---|---|---|---|

| 発行組織 | 経済産業省、総務省(日本) | NIST(米国) | ISO |

| 目的 | 安全・安心を伴ったAIの活用促進 | AIシステムの設計、開発、展開、使用において信頼性の考慮を組み込む能力を向上させるための自発的な使用 | AIの開発と展開におけるリスクを管理する体系的なアプローチを提供し、責任あるAI実践を促進すること |

| 主な対象 | AIの開発・利用・提供組織 | AIの開発組織 | AIの開発・利用・提供組織 |

| アプローチ | リスクベースアプローチ | リスクベースアプローチ | リスクベースアプローチ |

| ボリューム | 約200頁(内、本編35頁) | 約40頁(内、本編34頁) | 約60頁(内、本編25頁) |

| 種別 | 指針 | 指針 | 基準(認証/監査基準に利用可) |

| 特徴 | AIアジャイル・ガバナンスを柱にした考え方 | 開発のライフサイクル(7ステップ)、AIの信頼性(7要素)、リスクマネジメントの枠組み(4要素)で示している | AIのリスクアセスメントやAIシステム影響度評価プロセスについて言及。加えて、9分類・38個からなるAIリスク管理策を提示 |

| 言語 | 日本語 | 英語 | 英語(2024.04.23現在) |

AI事業者ガイドラインはEUや米国の法規制に対応するのか

どれだけ包括的なガイドラインであったとしても、各国のAI関連法規制を満たすものかどうかという点が最も気になるところです。果たして、企業はAI事業者ガイドラインに沿ってAIの開発や利用、提供を行えばそのまま自動的に国内外の法規制に準拠することができるのでしょうか。これを説明するために各国の法案についても簡単に触れておきます。

EUでは各国に先立ちAI法案が制定されました(2024年3月に欧州議会で可決)。このEUのAI法案はリスクベースアプローチを採用しています。AIシステムをリスクの大きさごとに4段階に分け、そのリスクの大きさに合わせて適用する規制の厳しさを変えています。なお、4段階とは「許容できないリスクAI」「ハイリスクAI」「限定リスクAI」「最小リスクAI」です。このうち「許容できないリスクAI」や「ハイリスクAI」のシステムには非常に厳しいルールが課せられており、このルールに違反した場合、最大3,500万ユーロ(約56億円、3月時点の為替レート)を超える規模の制裁金を課せられる可能性があります。なお、「ハイリスクAI」のシステムとは、安全部品や製品として使用され、第三者の適合性評価が必要なもの、または特定の用途に使用されるAIを指します。これに該当する場合は、ライフサイクル全体にわたる包括的なリスク管理システムを確立する必要があります。

また、米国で議会に提出されている法案の1つが、Artificial Intelligence Research, Innovation, and Accountability Act of 2023ですが、ここでもEUのAI法のようにAIシステムを「著しく重大な影響力を持つもの(Critical-impact artificial intelligences system)」と「重大な影響力を持つもの(High-impact artificial intelligence system)」の2つに分類し、それぞれに対して適用するルールを設けようとしています。なお、「著しく重大な影響力を持つもの」には、無許可で生体認証データを収集するAIや、重要インフラや宇宙基盤の直接管理運営、または刑事司法に関わる用途のAI等が該当します。この「著しく重大な影響力を持つもの」に関わるAIシステムを取り扱う場合は認証取得を行うことを求めています。

このように欧米ともに、その法案においてはAIの重要性に合わせたルール整備が進められていることがわかります。AI事業者ガイドラインでは高度なAIシステムについて言及していますが、これは最新のAIモデルを使っているかどうかの観点での定義であって、リスクの大きさを加味した「ハイリスクAI」や「重大な影響力を持つAI」といった分類はしていません。したがって、AIガバナンスの整備をAI事業者ガイドラインだけを見て進めるのでは不十分であり、各国の法規制を踏まえた追加の取り組みが必要だということがおわかりいただけると思います。

AI事業者ガイドラインの使い方

当該ガイドラインはAIの開発者のみならず、提供者や利用者をも対象にしたガイドラインであるため、基本的には組織においてAIの開発・導入推進やその管理責任を担う組織の全ての方々が参考にすべきガイドラインであると言えます。

このガイドラインの読み方としては、全体のボリュームが約200ページと多いため、はじめに本編に目を通し全体感を掴んだ上で、あとは別添にある2種類のチェックリストを使って自組織の現状評価から始めることが望ましいでしょう。評価をする中で、不明点や疑問点が出てきた時に改めて本編や別添の該当箇所をよく読み、理解に努める方法が最も効果的・効率的であると考えます。

グローバルな観点で法規制対応を検討されている組織の場合、先述の通り、AI事業者ガイドラインが諸外国の法規制全てをも包含しているわけではないため、このガイドラインに精通すると同時に、それら法規制に対する理解を深めることも必要不可欠です。

最後に、リスクアセスメントの手続きに関してですが、これはAIマネジメントシステムの国際規格であるISO/IEC42001が最も参考になると思われます。と言いますのも、先進国が定める法案やガイドラインはいずれもリスクベースアプローチを採用してはいますが、具体的なリスクアセスメントの手続きに関しては言及していないためです。